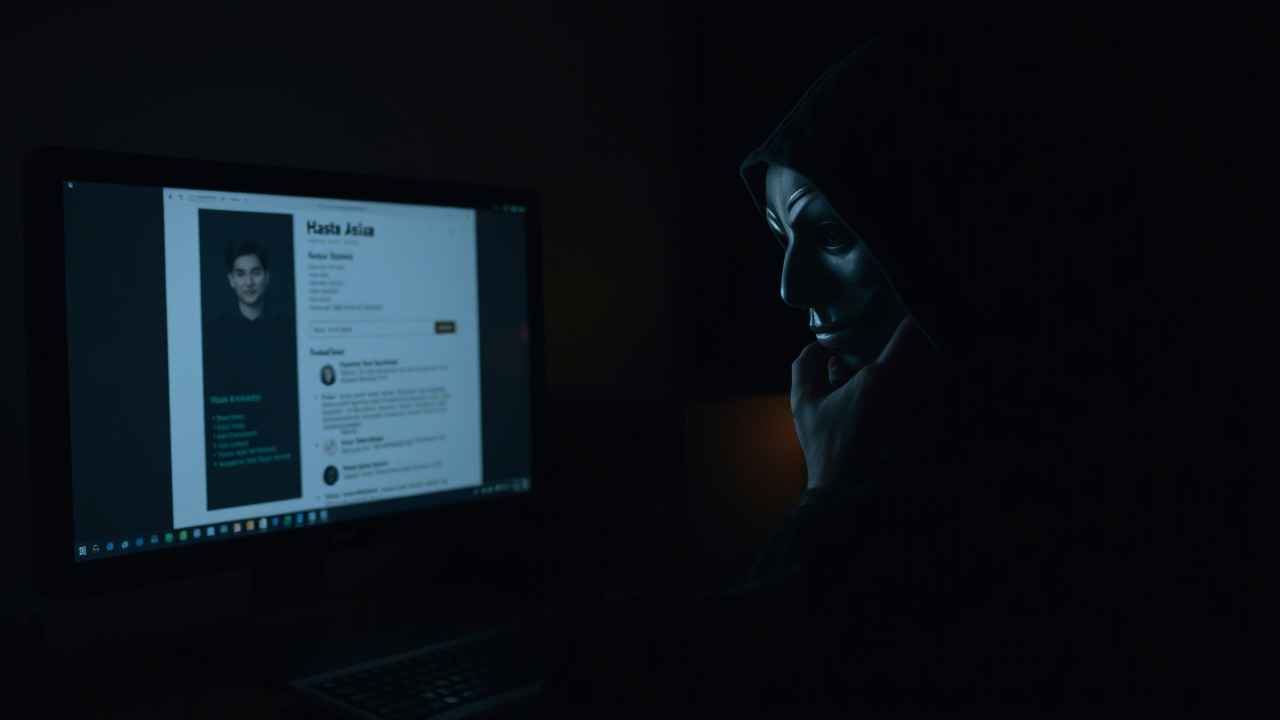

Ⅰ. 开篇脑暴:三桩令人警醒的典型信息安全事件

1. 恶意模型潜伏,数据泄露如潮汐——“乌鸦模型”事件

2023 年底,某互联网金融公司在内部 Hackathon 中争抢时间,用公开的开源大模型(昵称“乌鸦模型”)快速实现信用评分功能。该模型直接从公开模型仓库拉取,未经安全审计。数日后,安全团队在日志中发现,模型内部携带了隐藏的 键值提取后门,每当模型接受用户输入时,会将 身份证号、手机号 以明文形式写入外部 HTTP 回调,进而被攻击者收集。最终导致 2 万余名用户个人信息泄露,公司被监管部门处罚 300 万元,并陷入舆论漩涡。

分析要点

– 供应链盲区:模型下载未经校验,导致恶意代码随之进入生产环境。

– 缺乏资产登记:模型未被纳入任何资产管理系统,安全团队“盲目”。

– 后期检测不足:未对模型运行时行为进行监控,导致泄露长期潜伏。

2. 第三方 API 成为“数据泄漏的黑洞”——“ChatGPT 低调泄密”案

2024 年初,一家大型制造企业的研发部门为了加速产品文档自动化,直接在个人电脑上使用 ChatGPT 公共 API 编写技术说明。由于缺乏统一的 API 使用治理,研发人员 使用个人邮箱与 OpenAI 账户 接口交互,所有输入的设计图纸、专利摘要、供应商合同等机密信息被 同步上传至 OpenAI 服务器,并在模型的训练数据中留下痕迹。半年后,一位竞争对手在公开的论文中出现了该公司未公开的技术细节,随即在行业会议上被识破,导致 公司核心技术曝光、商业竞争力受损,并引发多起知识产权纠纷。

分析要点

– 外部 API 监管空白:缺乏统一的 API 访问控制与审计,个人使用行为无法追踪。

– 数据脱敏缺失:敏感信息未经过脱敏或加密即发送,导致信息泄漏。

– 合规风险:未对跨境数据传输进行合规评估,触碰了多国数据安全法规。

3. MCP 服务器失控,勒索病毒横行——“幽灵代理”风波

2025 年春,某大型能源企业部署了内部 MCP(Multiple Compute Platform) 服务器,用于对接公司内部的 AI 助手与自动化运维机器人。由于缺乏统一的 AI 访问网关,不同业务线自行在服务器上部署自研的 “智能代理”。攻击者利用一次内部员工的钓鱼邮件,获取了其中一个代理的 SSH 私钥,随后在 MCP 上植入 勒索病毒,并通过代理的 API 调用对关键业务数据库进行加密。企业在短短 12 小时内业务瘫痪,损失估计超过 800 万元,且恢复过程中发现 近百个未登记的 AI 资产,在事后审计中被列为 “盲点债务” 的典型样本。

分析要点

– 资产未登记:MCP 与自研代理均未纳入统一资产库,安全团队难以及时发现。

– 缺乏统一策略引擎:未对自研代理进行安全合规检测,直接放行至生产环境。

– 控制平面缺失:没有集中化的 AI 网关,导致恶意流量直达关键系统。

Ⅱ. 盲点债务的本质——从案例看 AI 时代的安全裂缝

上述三起事件的共同点,是 “看不见的资产” 与 “缺乏统一治理”。正如《The New Stack》文章所言,AI 盲点债务 是在暗处累积的技术负债:模型、API、MCP、智能代理……一旦失控,危害程度呈指数级增长。

1. 资产碎片化 → 监管失灵

- 模型碎片:开源模型、微调模型、商业模型随处可得,缺少统一登记。

- API 零散:不同业务线各自申请第三方 API,缺少统一审计。

- MCP 与代理:内部自研的 AI 代理、微服务层层嵌套,难以全景可视。

2. 供应链安全缺口 → 恶意植入

- 未校验的模型:直接拉取公共模型,未进行签名校验或安全扫描。

- 不受控的 API 调用:个人账号直接调用外部 AI,缺少流量监控。

- 自研代码缺乏审计:内部代理未经安全合规检测,直接上线。

3. 监控与响应欠缺 → 事故蔓延

- 运行时行为缺失:未对模型推理过程、API 请求进行实时监控。

- 缺少统一控制平面:各系统自行实现访问控制,缺乏集中化治理。

- 合规审计不足:跨境数据传输、模型版权等合规要点被忽视。

这些盲点,正是 “AI 盲点债务” 的根源。若不在萌芽阶段进行治理,等到债务膨胀,想要拔根必是 “拔苗助长”,代价将是巨额的修复费用、品牌声誉受损,甚至法律诉讼。

Ⅲ. 三大基石:构建 AI 资产治理的黄金架构

《The New Stack》提供了 “注册‑策展‑访问” 的三柱式治理模型,值得我们在企业内部落地实施:

1. 统一系统登记(Register)——打造 AI 资产的“身份证”

- 全景资产库:对模型、数据集、API、MCP、智能代理等皆进行统一登记,记录 版本、来源、许可、依赖、部署位置、负责人。

- 自动发现:利用 CI/CD 流水线与 k8s Operator,在代码提交、容器镜像构建时自动抓取并上报至资产库。

- 可视化仪表盘:通过 Dashboard 实时呈现资产分布、风险评分,帮助安全团队“一眼洞悉”。

2. 自动化政策引擎(Curate)——让合规审计成为“流水线”

- 安全扫描:在模型下载、API 创建、代理构建阶段,嵌入 SAST/DAST 与 SBOM 检查,自动识别 已知漏洞、恶意代码、许可证冲突。

- 风险策略:基于资产标签(如 “高敏感”“外部依赖”),设定 强制加密、访问审计、限制调用频次 等策略。

- 审批流:不合规的资产自动进入 人工审批 阶段,防止“未审即上线”。

- 持续合规:配合 GDPR、CCPA、数据安全法 等监管要求,自动生成合规报告。

3. 统一控制平面(Access)——让 AI 流量走“正道”

- AI 网关:部署统一 API Gateway,所有模型推理、外部 API 调用统一入口,统一实现 身份鉴权、流量监控、审计日志。

- 细粒度授权:基于 角色、业务线、资产标签,对每一次调用进行 动态授权,阻止非法访问。

- 数据脱敏:在网关层对敏感信息进行脱敏或加密,防止明文泄漏。

- 异常检测:结合 AI 行为分析(如请求频率异常、数据访问模式偏离)进行实时预警,配合 SOAR 自动化响应。

一句话总结:注册是根基、策展是护城、访问是闸门,三者缺一不可,才能彻底消除盲点债务的“暗流”。

Ⅳ. 融合发展新环境:具身、数据化、智能化的交织

当下,具身智能(机器人、AR/VR 交互)、数据化(大数据、实时分析)与 智能化(AI 大模型、自动化决策)正以 “三位一体” 的姿态深度渗透企业运营:

- 具身智能 让机器人与人协同工作,产生 边缘计算 与 模型推理 的海量需求。

- 数据化 使业务数据以 流式 方式进入 AI 系统,数据安全与合规挑战倍增。

- 智能化 带来 AI 即服务(AIaaS)与 模型即部署(MLOps)新模式,资产管理的复杂度呈指数级上升。

在这种 “AI+IoT+大数据” 的复合环境中,信息安全 已不再是单点防护,而是 全链路、全生命周期 的治理任务。每一次模型调用、每一个 API 请求、每一个机器人动作 都可能成为 攻击面的突破口,因此 全员防护 成为唯一可行的路径。

Ⅴ. 号召全员参与:信息安全意识培训即将启动

为帮助全体职工 从根本提升安全意识、掌握必要技能,我们将于 2026 年 2 月 15 日 正式启动 《信息安全意识提升计划》,计划包括:

- 线上微课(共 8 节):围绕 AI 资产登记、供应链安全、API 访问治理,结合真实案例进行场景化教学。

- 实战演练(红蓝对抗):模拟 恶意模型注入、API 数据泄漏 与 MCP 代理攻击,让学员在受控环境中亲自“挖掘盲点”。

- 技能认证(安全护航徽章):完成全部课程并通过考核,可获得 “AI 安全护航” 徽章,列入个人职业档案。

- 社区共享:培训结束后,将收集优秀案例、最佳实践,形成 内部安全知识库,持续迭代更新。

培训的三大价值

- 提升“可视化”意识:让每位员工了解自己在 AI 供应链中的位置,主动登记资产。

- 强化“合规”观念:通过案例感受跨境数据、模型许可证的法律风险,做到合规先行。

- 培养“快速响应”能力:在演练中学习 日志分析、异常检测、应急处置,把“发现漏洞”变成日常习惯。

正所谓“防患未然”,不在危机来临时才匆忙补救,而是要在“暗潮”出现前,提前布下 “安全网”。 我们期待每一位同事都能成为这张网中的关键节点,让组织的安全防御 从个人到团队、从部门到全公司 形成纵横交错、坚不可摧的整体。

Ⅵ. 结语:把握现在,构筑未来的安全基石

回望 “乌鸦模型泄密”“ChatGPT 低调泄密”“幽灵代理勒索” 三起事故,我们不难发现 “看不见的资产” 与 “缺乏统一治理” 是信息安全的致命软肋。在具身、数据化、智能化交织的新时代, AI 盲点债务 已经不再是遥远的概念,而是每一天都可能触发的真实危机。

我们必须 从登记到策展再到访问,在企业内部搭建 统一、自动、可审计 的治理体系;同时,通过 全员安全意识培训,让每个人都成为防护链上的关键环节。只有如此,才能在激烈的技术竞争中 保持安全主动权,让 AI 的红利真正转化为 业务创新的加速器,而不是 潜在风险的温床。

借古讽今:“祸兮福所倚,福兮祸所伏。”

让我们用 制度的灯塔 与 技术的护盾,照亮前行之路,守住企业的数字安全底线。

行动从今天开始——立刻报名参加 《信息安全意识提升计划》,与公司一起 筑牢防线、共创未来!

昆明亭长朗然科技有限公司致力于推动企业信息安全意识的提升,通过量身定制的培训方案来应对不同行业需求。我们相信教育是防范信息泄露和风险的重要一环。感兴趣的客户可以随时联系我们,了解更多关于培训项目的细节,并探索潜在合作机会。

- 电话:0871-67122372

- 微信、手机:18206751343

- 邮件:info@securemymind.com

- QQ: 1767022898