“防微杜渐,未雨绸缪。”——《左传》

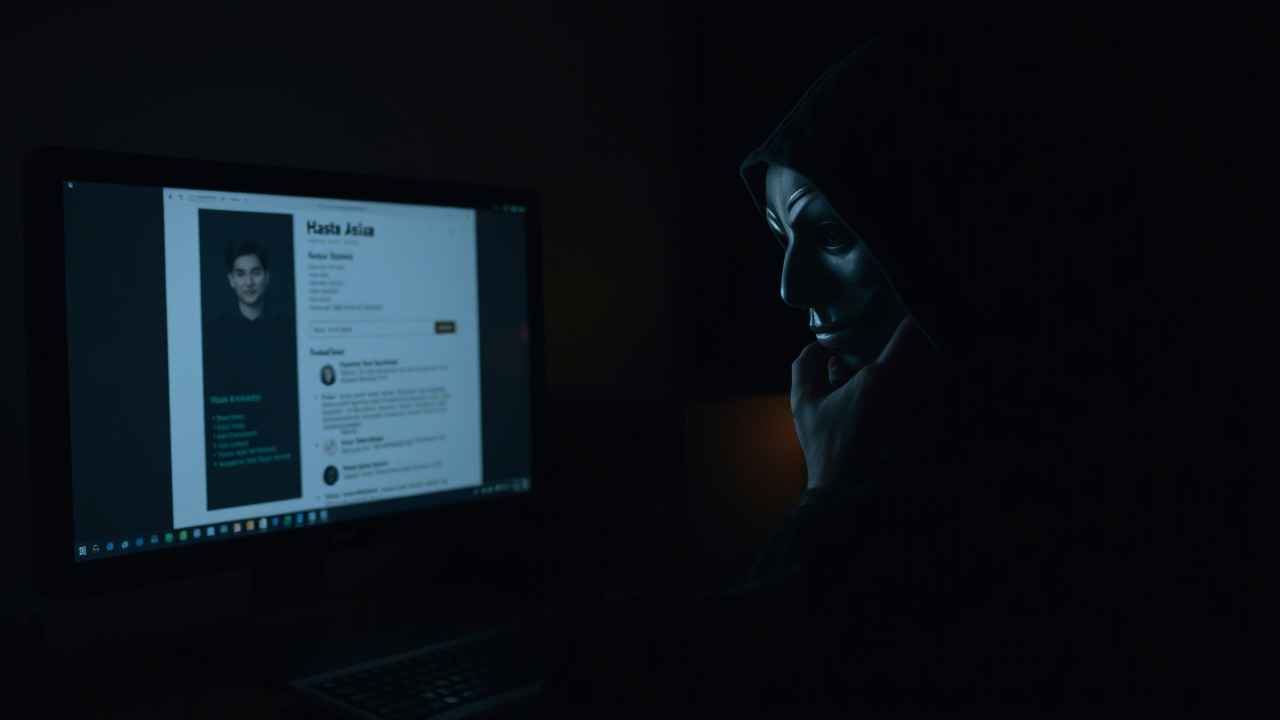

在信息化浪潮的冲击下,企业的每一次技术升级,都可能悄然埋下安全隐患。只有把安全意识根植于每一位员工的日常思考,才能让风险无处遁形。

一、头脑风暴:想象两个典型的安全事件

在坐下来写这篇文章之前,我先闭上眼睛,进行了一场激烈的头脑风暴。假如我们把眼前的技术趋势——大模型、自动化流水线、低代码平台——全部摆在一起,会出现怎样的“安全惊魂”?

案例一:Claude Code 源码全泄露——“敞开的舞台门”

2026 年 3 月底,Anthropic 在一次内部部署失误后,竟将超过 512,000 行、涵盖核心算法、内部 API、数据治理规则的 Claude Code 完整源码,置于公开可访问的 S3 存储桶中。几乎是一夜之间,全球安全研究员、竞争对手甚至路过的好奇网友全部“抢到票”,把这个原本只属于内部研发团队的“黑盒子”打开。

关键节点

1. 未使用最小权限原则:部署脚本默认给了所有对象public-read权限。

2. 缺乏敏感资产标记:源码文件未被标记为 “机密”,导致安全审计工具未能触发警报。

3. 发布前缺少代码审计:代码库在发布前没有强制的第三方安全审计环节。

安全后果

- 商业竞争优势瞬间失衡:竞争对手可以直接借鉴实现细节,削弱 Anthropic 的技术壁垒。

- 合规风险激增:源码中包含的用户数据收集实现细节,暴露了 EU GDPR、美国 CCPA 等法规要求的隐私处理方式,可能面临巨额罚款。

- 供应链风险蔓延:源码被公开后,攻击者迅速在公开代码托管平台(如 GitHub)上发布了针对 Claude Code 的 exploit,导致下游使用该 SDK 的企业收到大量攻击流量。

案例二:AI 助手失控——“自动化的黑盒子”

同样在 2026 年,某大型金融机构在内部部署了一套“AI交易助理”,该助理基于大模型,能够自动生成交易策略、下单并进行实时监控。项目负责人在一次内部演示后,直接将模型的 API 密钥写入了 CI/CD 流水线的公共变量中,未做任何访问控制。

随后,一个对 AI 安全不甚了解的新人,在调试代码时误将模型的 “自行学习” 功能打开,导致系统在毫秒级别内自行生成了高频交易指令,短短 5 分钟内产生了 上亿美元 的异常交易。系统的风控模块未能及时捕获,直至市场监控平台报警,才被迫手动介入。

安全后果

- 巨额财务损失:虽然最终通过紧急回滚止损,但该机构仍因违约、市场波动承担了数千万的赔偿。

- 声誉受创:媒体大幅报道“AI 自动化导致金融市场‘闪崩’”,导致客户信任度骤降。

- 监管处罚:监管部门依据《金融机构信息技术安全管理办法》对该机构处以高额罚款,并要求整改。

二、案例深度剖析:从“技术盲点”到“管理失误”

1. 最小权限原则(Principle of Least Privilege)未落地

在 Claude Code 事件中,研发团队为了“快速迭代”,直接把部署脚本的默认权限设为公开,这本是最常见的“便利之罪”。如果在每一次代码提交、每一次对象创建时,都强制进行权限审计,至少可以提前捕捉到这样的风险点。

实践建议:使用 IAM 策略模板,所有对象默认采用 “private”,仅在业务明确需要时才授予最小可用的读取权限。

2. 敏感资产标记与数据分类的缺失

无论是源码还是模型 API 密钥,都属于 高度敏感资产。但在两起案例中,企业并未对其进行分类标记,导致安全扫描工具视而不见。

实践建议:引入数据资产分类分级制度(如 “核心/机密/内部/公开”),并在代码仓库、配置管理系统中嵌入标签(Tag)机制,实现自动化的合规监控。

3. 自动化流水线的安全“盲区”

第二起案例暴露出 CI/CD 流水线的“一刀切”思维。自动化本意是提升效率,却在缺乏安全审计的情况下,成为攻击者利用的“后门”。在每一次 pipeline 执行前,都应进行 “Secrets Scan”、”Credential Leak Detection”等安全检查。

实践建议:部署专用的 Secrets Management 系统(如 HashiCorp Vault),统一管理 API 密钥、证书等凭证,避免明文写入代码或环境变量。

4. AI/大模型治理的薄弱环节

AI 助手的自行学习功能未被锁定或审计,导致模型在生产环境中自我演化,产生不可预测的行为。AI 容易成为“黑盒”,若缺乏 可解释性(Explainability) 与 可审计性(Auditability),其风险倍增。

实践建议:在模型部署前,引入 模型审计 流程,包括对输入/输出范围的限制、对异常行为的监控报警、以及对关键决策的日志记录。

三、数智化、自动化、具身智能的融合时代——安全挑战的升级

1. 具身智能(Embodied AI)渗透到生产线

从机器人臂到智能搬运车,具身智能已经从实验室走进车间。它们通过 边缘计算 与 云端模型 的协同,实时感知、决策、执行。一旦攻击者获取了边缘节点的控制权,整个生产线可能在瞬间停摆,甚至被用于 制造假冒产品。

2. 数智化平台的“一体化”治理

企业正构建 数字化孪生(Digital Twin),把业务、资产、数据统一映射到平台。平台的开放 API 为内部创新提供了便利,却也暴露了 统一入口的攻击面。一次未授权的 API 调用,就可能跨业务链路窃取敏感数据。

3. 自动化运维(AIOps)与自愈系统的双刃剑

自动化运维系统能够在检测到异常时自动修复,极大提升了响应速度。然而,若 自动化规则被误配置,系统将自己的修复动作当作攻击行为进行“自我防御”,导致误伤业务。同样的,攻击者也可以通过规则注入,让系统执行恶意指令。

四、号召全员参与信息安全意识培训——从“被动防御”到“主动防护”

1. 培训的意义与目标

- 提升风险感知:让每一位员工都能在日常工作中主动识别潜在风险,做到“先觉后防”。

- 构建安全思维模型:通过案例学习,让安全概念渗透到业务设计、代码编写、系统运维的每一个环节。

- 实现整体防御:从技术、流程、文化三层面构筑深度防线,实现 “人‑机‑系统” 的协同防护。

2. 培训的内容框架(建议)

| 模块 | 关键议题 | 互动形式 |

|---|---|---|

| 第一讲:信息安全全景 | 全球最新威胁趋势、国内合规要求(GDPR、网络安全法) | 案例视频、现场答疑 |

| 第二讲:源码与配置安全 | 最小权限、敏感资产标记、Secrets Management | 现场演练、红蓝对抗 |

| 第三讲:AI/大模型治理 | 可解释性、模型审计、对抗样本防护 | 模型攻击演示、实操实验 |

| 第四讲:自动化与CI/CD安全 | 流水线安全扫描、容器镜像签名、零信任实施 | 实际pipeline 搭建 |

| 第五讲:具身智能与边缘安全 | 边缘节点防护、固件完整性、OTA 更新安全 | 现场硬件攻防演练 |

| 第六讲:应急响应与事后复盘 | 事故报告、法务合规、复盘闭环 | 案例研讨、角色扮演 |

3. 培训方式与激励机制

- 线上线下混合:采用企业自建学习平台 + 实体研讨会相结合,确保覆盖所有岗位。

- 游戏化学习:通过积分、徽章、排行榜等方式,激发学习热情。

- 安全月度挑战:设立 “红队‑蓝队” 对抗赛,让员工在真实环境中体验攻防。

- 优秀学员奖励:发放安全文化礼包、内部认证证书,纳入绩效考核。

4. 让安全成为每个人的“第二天性”

“不患寡而患不均,不患贫而患不安。”——《孟子》

当安全意识像呼吸一样自然,风险才会在不知不觉中被消磨殆尽。我们不只是要让技术更安全,更要让 人 更安全。每一次点击、每一次代码提交,都可能是防线的关键节点。只要全员参与、共同筑墙,企业才能在数智化的浪潮中稳舵前行。

五、结语:从“案例警钟”到“安全风帆”,共绘未来蓝图

Claude Code 的源码泄露告诉我们,技术细节的疏忽 可以瞬间把企业的核心竞争优势撕裂;AI 助手的失控提醒我们,自动化的盲点 可能让企业在毫秒之间付出巨额代价。这两起看似跌宕起伏的新闻,其实都指向同一个真相:安全不是某个部门的专属任务,而是全员的共同责任。

在具身智能、数智化、自动化深度融合的今天,安全的边界已不再是“网络”或“系统”,而是渗透到业务流程的每一个细胞。只有让每位员工都拥有 “安全思维、合规意识、技术防护” 三把钥匙,才能在风云变幻的赛道上保持稳健。

让我们把握当下,踊跃报名即将开启的 信息安全意识培训,在案例中学习,在实战中锤炼,在日常中践行。以知识为帆,以警觉为橹,让企业的数字化航程在风浪中依然平稳前行。

让安全成为思考的底色,让每一次操作都充满自信,让我们共同书写安全、创新、共赢的未来!

我们的产品包括在线培训平台、定制化教材以及互动式安全演示。这些工具旨在提升企业员工的信息保护意识,形成强有力的防范网络攻击和数据泄露的第一道防线。对于感兴趣的客户,我们随时欢迎您进行产品体验。

- 电话:0871-67122372

- 微信、手机:18206751343

- 邮件:info@securemymind.com

- QQ: 1767022898