前言:头脑风暴·想象力的三幕剧

在座的每一位同事,或许都曾在日常工作中对「数据」与「AI」抱有无限憧憬:AI 可以自动生成报告,机器学习模型可以从海量日志中捕捉异常,机器人可以代替人手完成繁重的运维任务。正因如此,「我们已经把 AI 放进了生产环境」这句话不再是未来的口号,而是当下的现实。

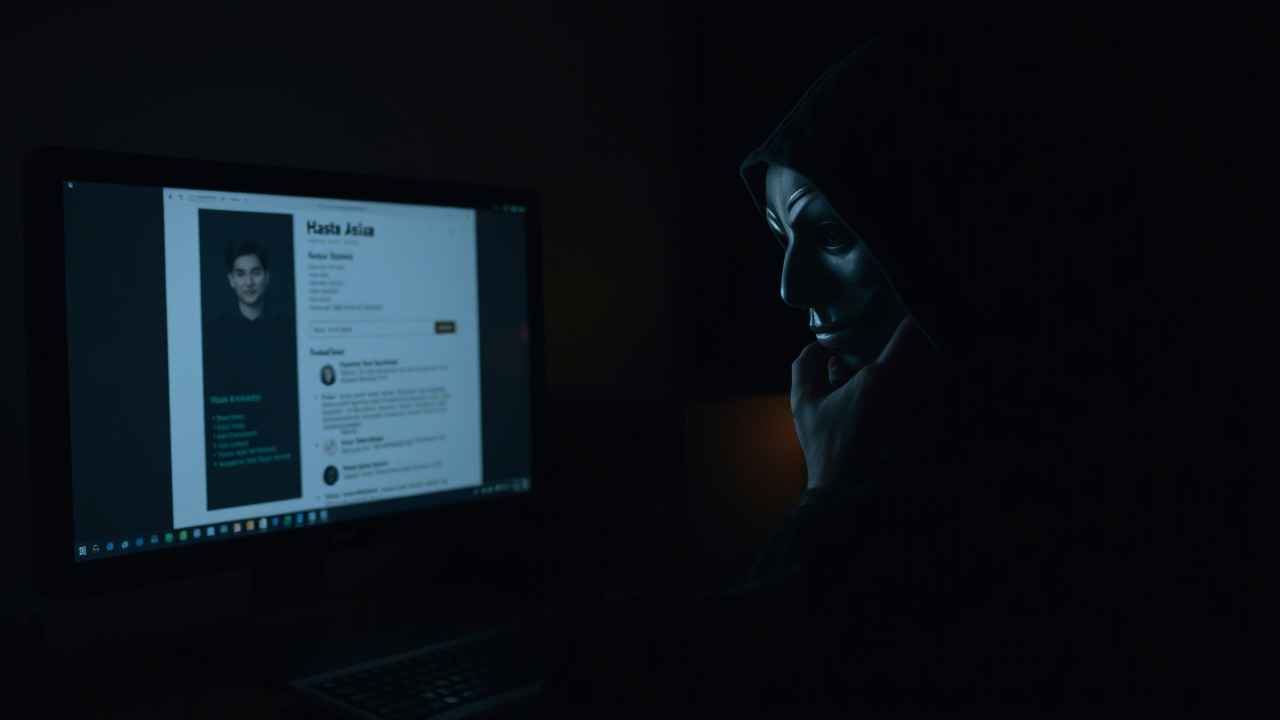

然而,当「信任」与「治理」没有同步升级,危机往往在不经意间潜伏。下面,我用三则想象中的信息安全事件,帮助大家洞悉「隐形裂缝」的真实危害。

案例一:AI‑SQL「幽灵」导致财务报表失真

背景

某大型制造企业在引入 LLM(大语言模型)辅助开发后,数据库运维团队决定让 AI 自动生成日常报表的 SQL 脚本。AI 根据历史报表模板自行编写 SELECT 语句,并通过 CI/CD 流水线直接推送到生产库。

事件

一次例行的季度财务审计中,审计师发现 Q2 的收入数字比前一年增长 48%。然而,深入比对后发现,AI 产生的 SQL 在一个视图中误将「预估收入」字段误写为「已实现收入」并强行覆盖了原始数据。由于没有审计日志记录这一次自动化变更,财务团队在两周内都未能发现异常,直至财务总监在例会上看到与实际收款不符的数字,才引起警觉。

原因剖析

– 数据质量失控:AI 生成的 SQL 未经过人工复核或自动化校验,导致错误直接写入生产库。

– 治理缺失:缺少标准化的 Schema 版本管理和变更审计,导致「谁改了、改了什么、何时改的」信息缺失。

– 审计危机:监管机构要求提供变更记录时,只能提供 Slack 聊天截图,证据不具备法律效力。

教训

AI 不是万能的代笔人,尤其当它涉及关键业务数据时,必须把「自动化」与「治理」双管齐下,否则将成为「看不见的刀」割裂企业信任链。

案例二:机器人流程自动化(RPA)误触敏感表,导致泄密

背景

一家金融服务公司在推动数智化转型时,引入了基于视觉识别的机器人流程自动化(RPA)来完成客户开户的后台数据录入。RPA 通过 OCR 读取扫描件后,将信息写入 PostgreSQL 客户信息表。

事件

某天,RPA 机器人在处理一批高频批量文件时,因 OCR 误识别将「身份号码」字段的前两位当成了「国家代码」并错误写入「跨境支付」表的「收款账户」字段。随后,系统的 AI 监控模块将这批异常的跨境支付请求自动提交给外部支付网关,导致 30 笔涉外转账金额合计约 150 万美元被错误转出。虽然转账在 48 小时内被拦截,但已对客户信任造成不可逆的损害。

原因剖析

– 模型漂移:AI 训练数据未及时更新,导致 OCR 在新字体上表现下降。

– 缺乏跨系统治理:机器人跨库写入时未经过统一的 Schema 验证,导致数据结构不匹配。

– 证据缺失:事后只能通过机器人运行日志追溯,未能提供实时的「数据变更全景」。

教训

在机器人化、数智化的浪潮中,每一次跨系统的数据写入都必须走「统一治理」的“金丝雀”:统一的元数据管理、自动化的漂移检测与审计,才能让机器人真正成为可信的「左膀右臂」。

案例三:AI 生成代码导致后门植入,安全审计陷入泥沼

背景

一家互联网公司在内部开发平台上引入了「AI 助手」来辅助工程师编写微服务代码。AI 能根据需求描述自动生成 CRUD 接口的代码框架,并直接提交到 Git 仓库。

事件

一次安全审计中,审计员发现某微服务的日志模块在写入数据库时,意外泄露了环境变量(包括数据库凭证)的信息。进一步追踪代码提交历史后,发现这段异常代码正是 AI 在两个月前自动生成的「统一错误处理」函数。由于该函数在多个服务中复用,导致跨服务的凭证泄露。更糟糕的是,AI 生成的代码未能通过组织内部的「代码审查」流程,直接进入 CI,导致审计团队只能在事后通过「代码静态扫描」发现问题,修复成本高昂。

原因剖析

– 缺乏自动化策略校验:AI 产出的代码未经过「安全策略」自动化检查(如凭证泄露检测)。

– 治理仅停留在「人工审批」层面:代码审查的人工环节被 AI 的速度冲淡,导致「有审查」变成「审查走形式」。

– 审计证据不完整:AI 生成的代码缺少可追溯的「生成者身份」与「生成时的上下文」,审计时只能靠二次推断。

教训

AI 代码生成虽能提升开发效率,却必须嵌入安全治理管道,让每一行代码都在「策略即代码」的框架下接受审计,才能避免「看不见的后门」危害全局。

把「信任」写进系统:从「感性」到「理性」的转变

以上三个案例,虽然是想象中的情景,却紧扣 2026 年《数据库变更治理报告》 中的三大痛点:

- 数据质量是 AI 风险的首位(64% 受访企业如此认为)。

- 治理政策的执行率只有 28%,大多数组织仍停留在「有政策」但「不执行」的阶段。

- 审计证据往往只能在危机后拼凑,导致合规成本飙升。

我们必须认识到,「信任」不再是抽象的情感,而是可以被量化、被嵌入系统的属性。在具身智能、数智化、机器人化融合的今天,治理的“金丝雀”必须具备以下三大特征:

- 自动化:所有变更、所有 AI 产出、所有机器人操作,都必须经过机器可读的元数据校验与策略执行(如 Liquibase Secure 所倡导的自动化政策 enforcement)。

- 始终如一:控制点不能出现「有时」或「偶尔」的模糊选项,必须是「每一次」都生效的必经之路。

- 跨平台统一:无论是 PostgreSQL、Snowflake、Databricks 还是 MongoDB,治理模型必须统一,形成“一套标准、全平台覆盖”。

呼吁行动:加入信息安全意识培训,筑牢个人与组织的防线

为什么每位职工都需要参与?

- AI 已经在生产数据库里「当家」。如果你在日常工作中接触到数据、代码、自动化脚本,任何一次不经意的操作都有可能触发上述风险。

- 合规监管日趋严格:监管机构不再满足于「是否有流程」的回答,而是要看「流程是否在每一次变更中被真实执行」并留下「不可篡改的证据」。

- 职业竞争力的加分点:具备信息安全治理意识与实战能力的员工,已成为企业数字化转型的核心资产。

培训的核心内容

- AI 产出治理实务:如何使用自动化工具(如 Liquibase Secure)对 AI 生成的 SQL、代码、配置进行校验与审计。

- 机器人流程安全基线:RPA、机器人臂、IoT 设备在数据写入时的元数据约束与漂移检测。

- 审计证据的完整链路:从需求、实现、测试到部署的全链路元数据记录方式,以及如何在审计时快速提供可信证据。

- 案例复盘:通过真实或模拟的安全事件演练,让每位学员亲身体验「事件发现 → 痕迹追踪 → 根因分析 → 修复闭环」的完整流程。

参与方式

- 报名渠道:公司内部学习平台(ELearning)→ “信息安全意识提升计划” → 报名 “AI 与数据库治理专项”。

- 培训时间:2026 年 5 月 10 日至 5 月 24 日,线上直播 + 线下工作坊双模式。

- 奖励机制:完成全部模块并通过考核的同事,将获得公司颁发的「信息安全守护者」徽章,并计入年度绩效加分。

一句话点题:「安全不是事后补丁,而是系统的第一层代码」。让我们一起把安全思维写进每一次提交、每一次部署、每一次机器人的指令里。

结语:从「感性」到「理性」——让安全成为组织的硬核属性

在 AI 与机器人横扫各行各业的时代,「信任」不应该是靠感觉来填补的空洞,而应该是系统内部被硬编码的属性。我们看到,仅有 28% 的组织实现了成熟治理,这意味着大多数企业仍在「口号」与「实践」之间徘徊。随着监管压力上升、AI 产出规模膨胀,「治理缺口」只会以指数级别扩大。

今天,我以三个案例为镜,向大家敲响警钟,也诚挚邀请每一位同事加入即将开展的信息安全意识培训。让我们把“自动化”与“治理”紧密结合,把“AI 生成”转化为“合规产出”,把“机器人操作”升级为“受控执行”。只有这样,企业才能在数智化浪潮中稳坐舵手,员工才能在职业道路上更有底气。

让我们一起,站在信息安全的最前线,把每一次创新的背后,都铺上一层坚实的安全底座!

昆明亭长朗然科技有限公司提供一站式信息安全咨询服务,团队经验丰富、专业素养高。我们为企业定制化的方案能够有效减轻风险并增强内部防御能力。希望与我们合作的客户可以随时来电或发邮件。

- 电话:0871-67122372

- 微信、手机:18206751343

- 邮件:info@securemymind.com

- QQ: 1767022898