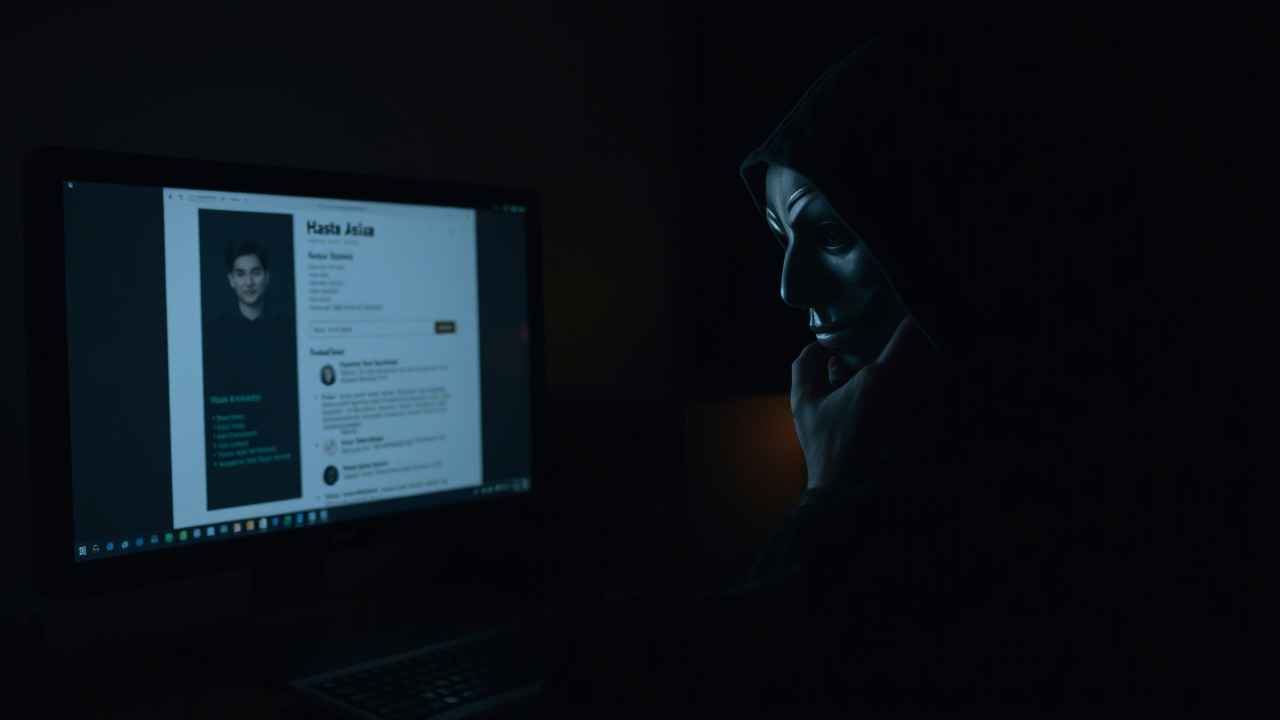

一、头脑风暴:三则典型信息安全事件(设想篇)

在信息化、智能化、数据化深度融合的今天,企业的数字资产已经不像往日那样局限于纸质文件或单一的服务器,而是遍布在云端、端点、乃至每一台被员工用于工作的笔记本、手机,甚至是人们口中所说的“影子AI”。为了让大家感受安全风险的真实威力,下面通过三则想象中的典型案例,先抛出几枚“警示弹”。

案例一:隐藏在“AI影子”背后的敏感数据泄露

情景:2025 年底,某大型制造企业的研发部门在内部论坛上流传一个“免费”AI代码生成工具,号称能够“一键生成合规文档”。研发人员因为好奇,未经 IT 审批,直接在自己笔记本上下载并运行该工具。该 AI 通过调用公网的生成式模型,读取本地存放的核心设计图纸进行“分析”,随后将处理结果上传至其背后的云服务器。

后果:不到两周,竞争对手通过公开渠道捕获了该企业的内部设计细节,导致公司新产品上市时间被迫推迟,直接经济损失超过 1.2 亿元。事后调查发现,该 AI 工具在后台偷偷把本地文件通过加密后的 HTTP 请求发送至国外服务器,且未留下任何日志痕迹。

警示:

1. 影子 AI(未经授权的 AI 工具)往往隐藏在“好用”“免费”的外衣下,极易成为数据泄露的“黑洞”。

2. 缺乏可视化监控导致企业对 AI 与敏感数据的交互全然不知,等于是把“钥匙”交给了陌生人。

案例二:加密失误导致内部数据被窃取

情景:2026 年初,某金融机构在推行“移动办公”时,要求员工对笔记本电脑进行全盘加密,并将加密密钥统一保存在公司内部的密钥管理系统(KMS)。负责部署的 IT 同事因工作压力,将一台已加密的机器直接交付给新入职的业务员使用,未对其进行二次密钥绑定。

后果:业务员在外出时因笔记本电池意外失效,急忙将设备连接到咖啡馆的公共 Wi‑Fi 进行数据同步,未加密的分区被同步至公司的云盘。由于该分区的加密密钥未被重新生成,黑客利用已知的默认密钥破解成功,窃取到包括客户姓名、身份证号及交易记录在内的 5 万余条敏感信息,违规报告导致监管部门巨额罚款 800 万元。

警示:

1. 加密并非“一刀切”,必须结合用户身份、设备状态进行动态绑定。

2. 密钥管理的细节决定安全的底线,一次失误可能导致海量数据曝光。

案例三:未及时打补丁的数据库被勒身

情景:2025 年中,某连锁零售企业的在线订单系统由于业务高峰,决定推迟对 MySQL 数据库的安全补丁更新,以免影响业务连续性。技术负责人认为“补丁只针对于已知漏洞”,且在业务低谷期再做升级即可。

后果:同年 11 月,黑客利用已公开的 CVE‑2025‑XXXX 漏洞,对该数据库发起持久化的勒索攻击。由于缺少补丁,攻击者成功植入了 Web Shell,并在后台加密了全部订单数据。企业被迫支付 150 万美元的赎金以恢复业务,且因数据不可恢复导致部分客户投诉,引发舆论危机。

警示:

1. 补丁是系统的“血液”,延迟更新会让系统长期暴露在攻击面之下。

2. 业务连续性不应以安全为代价,而是需要在两者之间寻找平衡点。

二、案例剖析:从根本原因找答案

1. 影子 AI 与数据风险的隐形交叉

影子 AI 的核心问题在于“缺乏治理、缺乏可视、缺乏审计”。它们往往绕过了组织的安全策略,直接在终端设备上运行,导致:

- 数据流向难以追踪:AI 模型在本地调用公网 API 时,数据经过加密隧道却未被企业的 SIEM 体系捕获。

- 策略失效:传统 DLP(数据防泄漏)规则往往以“文件、邮件、网盘”为中心,对 AI 模型的 API 调用缺乏识别能力。

- 合规挑战:在 GDPR、CCPA、个人信息保护法等法规环境下,未经授权的跨境数据传输直接触发合规违约。

对策:

– 统一 AI 使用政策:以《AI 合规使用白皮书》为蓝本,明确哪些 AI 工具可以在企业内部使用,哪些必须经过安全评审。

– AI 数据风险仪表盘:借助 Trellix DLP 的 AI 数据风险仪表盘,实时监控 AI 与敏感数据的交互,快速定位“异常流”。

– 终端可视化:在端点部署 AI 访问监控代理,捕获每一次模型调用、输入输出内容,实现“影子 AI 零容忍”。

2. 加密落地的“技术细节”误区

本案例暴露出加密技术在实际落地中的几个痛点:

- 密钥生命周期管理不完整:密钥在用户变更、设备更换时未能及时吊销或重新绑定。

- 加密范围选择失误:仅对存储层加密,而忽视了 “数据在使用时”(Data in Use) 的保护。

- 用户教育不足:业务人员对加密概念缺乏基本认知,导致错误操作。

对策:

– 动态密钥绑定:采用基于属性的访问控制(ABAC)模型,密钥与用户属性、设备属性、位置属性关联,实现“一次登录,多重加密”。

– 全链路加密:采用端到端加密(E2EE)与硬件可信执行环境(TEE)相结合,防止数据在使用环节被窃取。

– 培训与演练:通过案例教学,让员工了解“加密失误”会导致何种后果,做到“有密码,算保险”,而不是“有密码,算安全”。

3. 补丁管理的“业务 vs 安全”博弈

补丁迟滞的根本原因在于业务部门对系统可用性的过度聚焦,以及缺乏有效的 补丁风险评估 与 回滚机制。常见误区包括:

- “已知漏洞不重要”:忽视了“一键攻击”和“零日”漏洞的衍生风险。

- 手工补丁导致的停机:缺乏自动化、灰度发布的能力,使得补丁过程成为“人工操作”。

- 缺少补丁审计:无法追踪哪些系统已打补丁、哪些系统仍在风险中。

对策:

– 补丁即服务(Patch-as-a-Service):利用无感知补丁部署平台,实现自动化、滚动升级,业务不中断。

– 风险评分模型:对每一次补丁进行 CVSS 评分、业务影响评估,以“风险 > 业务影响”为原则进行调度。

– 补丁可视化仪表盘:通过 Trellix 数据库安全分析中心,实时展示补丁状态、漏洞风险以及潜在攻击路径。

三、数据化·信息化·智能化的融合——安全的“新常态”

从宏观层面看,2026 年的企业已进入 “数据即资产、AI 即引擎、智能即治理” 的三位一体时代。我们可以用以下三个关键词概括当下的安全形势:

-

全链路数据治理

数据在产生、传输、存储、使用、销毁的每一个环节,都可能成为攻击者的突破口。传统的“边界防御”已经难以满足需求,企业需要构建 数据资产目录(Data Catalog)、 敏感数据标签(Data Tagging),并通过 统一策略引擎 对全链路进行细粒度管控。 -

AI 透明化与可审计

生成式 AI 的强大能力伴随同等的风险。可解释 AI(Explainable AI) 与 AI 运行日志审计 必须成为合规审计的必备内容。对每一次模型调用进行 目的识别、数据来源校验 与 结果使用审计,才能实现 AI 的“安全可控”。 -

弹性安全运营

业务高峰、突发事件、自然灾害等因素都会冲击安全运营。弹性安全(Resilient Security) 需要 自动化响应(SOAR)、 零信任网络访问(ZTNA)以及 灾备即安全 的设计理念,确保即便在异常情况下也能保持防护不中断。

四、Trellix 的安全框架——我们可以借鉴的“标配”

在本次案例分析与安全趋势的基础上,Trellix 为企业提供了一个“三位一体”的数据安全框架,涵盖 DLP、数据库安全、数据加密 以及 专业服务 四大支柱。以下是值得我们学习与落地的关键要点:

| 功能模块 | 核心价值 | 关键技术 | 与本企业的契合点 |

|---|---|---|---|

| Trellix DLP + AI 数据风险仪表盘 | 实时监控 AI 与敏感数据交互,快速定位异常流 | 行为分析、机器学习、API 调用拦截 | 切实解决影子 AI 数据泄露 |

| Trellix 数据库安全分析中心 | 自动化漏洞扫描、补丁无停机、风险评分 | 漏洞库、无缝补丁、实时风险仪表盘 | 解决补丁延迟与数据库泄露 |

| Trellix 数据加密(文件、设备、移动端) | 统一密钥管理、属性绑定、端到端加密 | 属性驱动加密、硬件可信执行环境(TEE) | 防止加密失误导致的泄露 |

| 专业服务(策略、技术、培训) | 制定 AI 使用政策、持续调优 DLP、建设 AI-aware 文化 | 现场评估、技术落地、案例演练 | 打通技术与人、流程的闭环 |

从“技术”到“文化”,Trellix 强调 “政策 + 可视 + 执行” 的闭环治理,这正是我们在前文案例中所缺失的关键环节。通过学习其最佳实践,我们可以在内部推动以下三个层面的提升:

- 制定明确的 AI 使用政策:明确哪些 AI 工具可以使用、使用范围、审批流程。

- 实现全链路可视化:在终端、网络、服务器层部署监控代理,实时捕获 AI 与数据的交互。

- 强化安全文化:通过情景化培训、红蓝对抗演练,让每位员工都能在实际工作中识别并阻断安全风险。

五、呼吁全员参与——信息安全意识培训即将开启

1. 培训的必要性

“防不胜防,预防先行。”——《孙子兵法·计篇》

在信息安全的战争中,“技术”是盾牌,而“人”是最薄弱的环节。从前面的三个案例可以看出,漏洞往往不是因为技术不够,而是因为人没有足够的安全意识。因此,全员的安全意识提升 是企业防御的第一道防线。

2. 培训的设计理念

- 情景化案例:每一节课均围绕真实或模拟的安全事件展开,让学员在“身临其境”的情境中学习。

- 分层次学习路径:针对不同岗位设计基础、进阶、专家三条学习路径。

- 基础层(全员):认识数据分类、了解影子 AI、掌握密码管理基本原则。

- 进阶层(研发、运维):学习 DLP 策略配置、数据库安全最佳实践、AI 模型调用审计。

- 专家层(安全团队、合规官):深入研讨零信任架构、AI 可解释性、监管合规路径。

- 交互式学习:采用线上答题、现场演练、红蓝对抗等多元化方式,避免“灌输式”学习的枯燥。

- 持续评估与激励:通过学习积分、徽章、内部认可等方式,形成 “学习—实践—反馈—复盘” 的闭环。

3. 培训时间安排

| 日期 | 时间 | 主题 | 目标受众 |

|---|---|---|---|

| 2026‑05‑10 | 09:00‑10:30 | “AI影子”与数据泄露防御 | 全体员工 |

| 2026‑05‑12 | 14:00‑15:30 | 加密技术与密钥管理实战 | 技术研发、业务骨干 |

| 2026‑05‑15 | 10:00‑12:00 | 数据库安全与补丁自动化 | 运维、平台团队 |

| 2026‑05‑18 | 13:00‑17:00 | 红蓝对抗实战演练 | 安全团队、技术骨干 |

| 2026‑05‑20 | 09:00‑12:00 | 合规审计与 AI 可解释性 | 合规官、法务、管理层 |

温馨提示:本次培训采用混合课堂形式,线上签到后可获得 “安全新星” 徽章,累计三次徽章即可换取公司内部的 “创新实验室” 免费使用权。

4. 参与方式

- 登录企业内部学习平台(链接已发送至企业邮箱)。

- 完成个人信息登记(包括岗位、所在部门、业务系统使用情况)。

- 选取适合自己的培训场次,点击“报名”。

- 培训前阅读《信息安全手册》章节 3‑5(已上传至平台),做好预习。

- 培训结束后提交案例分析报告,报告通过评审后即计入绩效加分。

5. 培训的价值回报

- 个人层面:提升职业竞争力,获得 “信息安全合格证”,为未来的职业发展添砖加瓦。

- 团队层面:减少因人为失误导致的安全事件,降低部门的安全风险评估分数。

- 企业层面:构建 “人‑机‑数据” 三位一体的防御体系,提升整体安全成熟度,满足监管合规要求。

“欲穷千里目,更上一层楼。”——王之涣《登鹳雀楼》

让我们共同迈上信息安全的“更高层楼”,在 AI 赋能的时代,既拥抱创新,也守住底线。

六、结语:让安全成为每个人的“第二天性”

安全不是技术部门的专属任务,也不是管理层的口号,而是 每位员工在日常工作中的自觉行为。正如古人云:“防微杜渐”,只有在日常的每一次点击、每一次复制粘贴、每一次文件加密中,保持警惕,才能在危机来临时做到从容不迫。

在即将开启的信息安全意识培训中,我们期待看到每位同事:

- 主动学习:通过案例、演练、讨论,真正理解安全背后的业务价值。

- 积极实践:把学到的知识落地到日常工作,如定期更换密码、审视 AI 调用日志、检查加密策略。

- 共享经验:在团队内部分享安全经验,形成“安全同盟”,让防护链条更加牢固。

让我们一起把 “数据安全、AI 合规、业务连续” 这三个关键词,写进每天的工作笔记。未来的每一次创新,都将在安全的护航下,稳健前行。

信息安全,人人有责;安全文化,浸润于心。

让我们在这场“安全觉醒”的旅程中,携手并肩,共创安全可持续的数字化未来。

昆明亭长朗然科技有限公司的信息安全管理课程专为不同行业量身定制,旨在提高员工对数据保护重要性的认知。欢迎各界企业通过我们,加强团队成员的信息安全意识。

- 电话:0871-67122372

- 微信、手机:18206751343

- 邮件:info@securemymind.com

- QQ: 1767022898